La inteligencia artificial en la fotografía ya no es ciencia ficción

Inteligencia artificial. Fue la palabra del año 2022, aunque en realidad sean dos, según la FundéuRAE (Fundación del Español Urgente). Y razones no faltan porque, a lo largo del año pasado, la IA dejó de ser un vocablo más de esos que nos entran por una oreja y acaban saliendo por la otra sin más consecuencias, para convertirse en el denominativo de algo lo suficientemente relevante como para empezar a retenerlo en nuestra cabeza. La inteligencia artificial en la fotografía ya no es ciencia ficción.

Digamos que con la IA ha pasado algo parecido a lo ocurrido con otro sintagma, cambio climático, dos palabras que también llevan décadas formando parte de ese vocabulario que, a pesar de los avisos, interpretábamos como algo ajeno a nuestras vidas hasta que, en plena crisis energética, llega el verano más caluroso de la historia, precisamente el del pasado 2022, y más de uno empieza a tomar conciencia de su significado y de las consecuencias de ignorarlo. Bienvenido sea, pues, aunque sea ya un poco tarde…

Contenido

- La inteligencia artificial en la fotografía

- Pongámonos en (mis) antecedentes

- Mi primer contacto con una IA

- Y de dar el golpe a romper la mesa

- Y en eso llega Midjourney y el mundo creativo se tambalea

- Muy bien ¿y cuál es el problema?

- ¿Conclusiones?

- ¿Sabías que ya puedes realizar búsqueda de imágenes por selfie? Entérate de esta novedad de IA

- Selfie

- Vivian Maier: la fotógrafa que nos enseñó a mirar la calle de otra forma

La inteligencia artificial en la fotografía

Hablar de inteligencia artificial era, hasta hace poco más de un año, hablar de ciencia ficción para la inmensa mayoría de los mortales. No sería así, sin duda, para compañías como OpenAI, desarrolladores de DALL-E o ChatGPT, quiénes, bien seguro, ya hace muchísimo tiempo que saben lo que se llevan entre manos. Fue precisamente DALL-E, concretamente la versión DALL-E 2, la que soltó la liebre, allá por abril del año pasado con aquella famosa imagen del astronauta montando a caballo, generada únicamente mediante inteligencia artificial.

Y no es que aquella fuera la primera imagen creada por una IA, sino que, más bien, fue la que pilló a más de uno con el pie cambiado. Hasta entonces, la generación de imágenes mediante inteligencia artificial dejaba bastante que desear, con resultados a medio camino entre la abstracción y el surrealismo más bizarro.

Aquella imagen realista de un astronauta paseando por el espacio a lomos de un caballo blanco fue el punto de partida de una vertiginosa evolución de la IA (menos de un año) como generadora de obras visuales que llegaría a su máxima controversia en septiembre de 2022, cuando una obra artística creada mediante inteligencia artificial ganaba el primer premio en un concurso de bellas artes de la Feria Estatal de Colorado (EE.UU.), provocando que saltaran chispas entre ilustradores y artistas gráficos.

Pero vamos por partes.

Hablar de inteligencia artificial era, hasta hace poco más de un año, hablar de ciencia ficción para la inmensa mayoría de los mortales.

Pongámonos en (mis) antecedentes

Descubrí la fotografía muy joven, con tan solo 15 primaveras cumplidas, el mismo año en que caía el Muro de Berlín, con lo que es evidente que, quién escribe estas líneas, o ya peina canas o ya no necesita peine. Y pongo esa fecha como punto de partida porque, a pesar de que ya había disparado alguna foto con una Werlisa compacta de mi padre, fue a finales de 1989 cuando, tras disparar y revelar mis primeras fotos “creativas” realizadas con una cámara réflex, una Olympus OM-1 prestada, me quedé prendado por la técnica y el proceso y por unos resultados, evidentemente todavía muy amateurs, pero lo suficientemente enigmáticos como para provocar en mí cierta obsesión que al poco tiempo se convirtió en la confirmación de mi vocación por la imagen, al principio por la fotografía, pero con el transcurso del tiempo, por otras disciplinas audiovisuales.

Descubrí la fotografía muy joven, con tan solo 15 primaveras cumplidas, el mismo año en que caía el Muro de Berlín, con lo que es evidente que, quién escribe estas líneas, o ya peina canas o ya no necesita peine.

Mis primeros 10 años como fotógrafo fueron exclusivamente analógicos, tanto en la captura como en el revelado y positivado químico, y con el predominio absoluto de la fotografía en blanco y negro, hasta que a finales de los 90 adquirí mi primer equipo informático, tras lo cual, lo analógico fue dando paso a los procesos digitales, abriéndome la puerta a otras disciplinas creativas como el diseño, el vídeo y la creación de proyectos de comunicación web, permitiendo que pudiera ganarme la vida como profesional multidisciplinar y crear mi propio estudio con el que llevo desarrollando todo tipo de proyectos de comunicación, imagen y publicidad desde hace 15 años.

Creo que es evidente que un viaje como este, bastante resumido, no es posible sin la aceptación y la inclusión de los avances tecnológicos a la hora de desarrollar una trayectoria profesional y creativa en el sector audiovisual. Un proceso que, os aseguro, no ha sido fácil, y que muchas veces ha implicado tener que enfrentarme a ciertas “certezas” personales y a la vulnerabilidad que uno siente cada vez que ha de salir de esa zona de confort que cree conocer y controlar, para tener que aprender de nuevo desde otra perspectiva. Por suerte, en mi caso, la curiosidad siempre ha sido una aliada, y en aceptar que no pasa nada por ser más aprendiz que maestro, las incertidumbres y las controversias acaban dando paso a la ilusión que produce el poder poner en práctica, tanto a nivel creativo como profesional, lo descubierto en cada nuevo proceso de aprendizaje e investigación.

Mi primer contacto con una IA

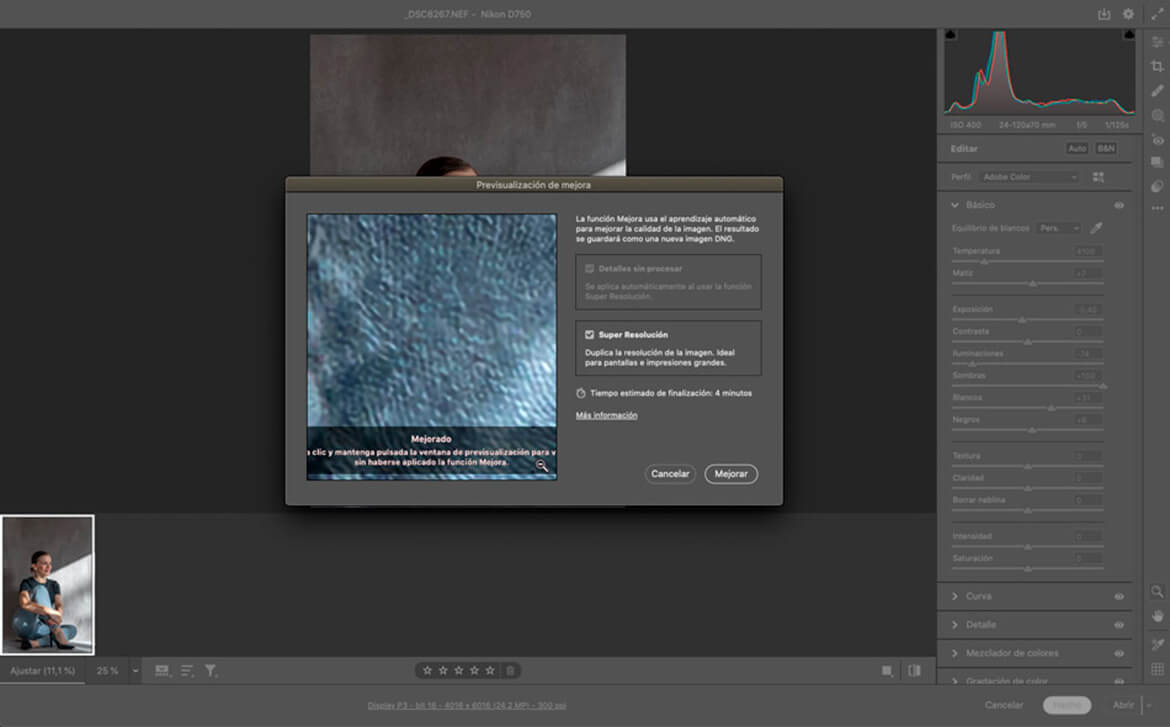

A principios de 2021, Adobe sorprendió a todos con una actualización de Adobe Camera Raw que incluía una nueva herramienta llamada Super Resolution que dejó a más de uno, incluido servidor, con la boca abierta, y supuso un golpe en la mesa por parte de Adobe en el eterno debate sobre la resolución y el tamaño del sensor a tener en cuenta a la hora de comprar una cámara fotográfica. De repente, la resolución de un archivo RAW ya no iba a depender exclusivamente de la tecnología de la cámara, sino directamente de la capacidad de un software que podía aumentar hasta 4 veces la resolución de la imagen original, con unos resultados que, si bien al principio evidenciaban ciertos defectos que había que pulir (nada que no se pudiera solucionar con otras herramientas de Camera Raw y Photoshop), con el tiempo han ido mejorando hasta el punto de poner en jaque la necesidad de una Full Frame bien cargada de megapíxeles.

Pues bien, Super Resolution fue posible gracias a una IA llamada Enhance Details, creada tan solo un par de años antes de su inclusión en Adobe Camera Raw y entrenada con millones de imágenes para que esta pudiera entender los patrones de la interpolación de una imagen y corregir con algoritmos los principales errores de pixelación y bandeo de color a la hora de interpolar una imagen, o sea, rellenar la información que falta en el original con otra ‘inventada’ para poder conseguir un tamaño mayor que este. No es que la interpolación sea algo nuevo para quienes trabajamos digitalmente las imágenes, pero sí es verdad que los resultados, sobre todo cuando la diferencia entre el tamaño del archivo original y el archivo de salida es considerable, más de una vez dejaban bastante que desear, por mucha postproducción que uno le metiera en el intento. Pero, de repente, una IA venía a resolver uno de los grandes quebraderos de cabeza de un fotógrafo o creativo digital y, encima, de manera automatizada y rápida, con unos resultados que, a medida que dicha IA sigue entrenándose, cada vez se acercan más a la perfección de un original capturado con un sensor de altísima resolución.

Super Resolution fue posible gracias a una IA llamada Enhance Details, creada tan solo un par de años antes de su inclusión en Adobe Camera Raw y entrenada con millones de imágenes para que esta pudiera entender los patrones de la interpolación de una imagen y corregir con algoritmos los principales errores de pixelación y bandeo de color a la hora de interpolar una imagen…

Y de dar el golpe a romper la mesa

¿Pero fue Adobe la compañía pionera a la hora de incluir la IA en los procesos de su software? Pues la verdad es que no, porque ya a finales de 2019, un viejo conocido de los plugins externos con posibilidad de integrarse en Photoshop y Lightroom, Topaz Labs, sorprendía a todos con la herramienta Sharpen AI, capaz de mejorar la nitidez de una imagen mediante la aplicación de una máscara de enfoque, corregir el foco e incluso estabilizar una imagen movida y, todo ello, con la IA de por medio.

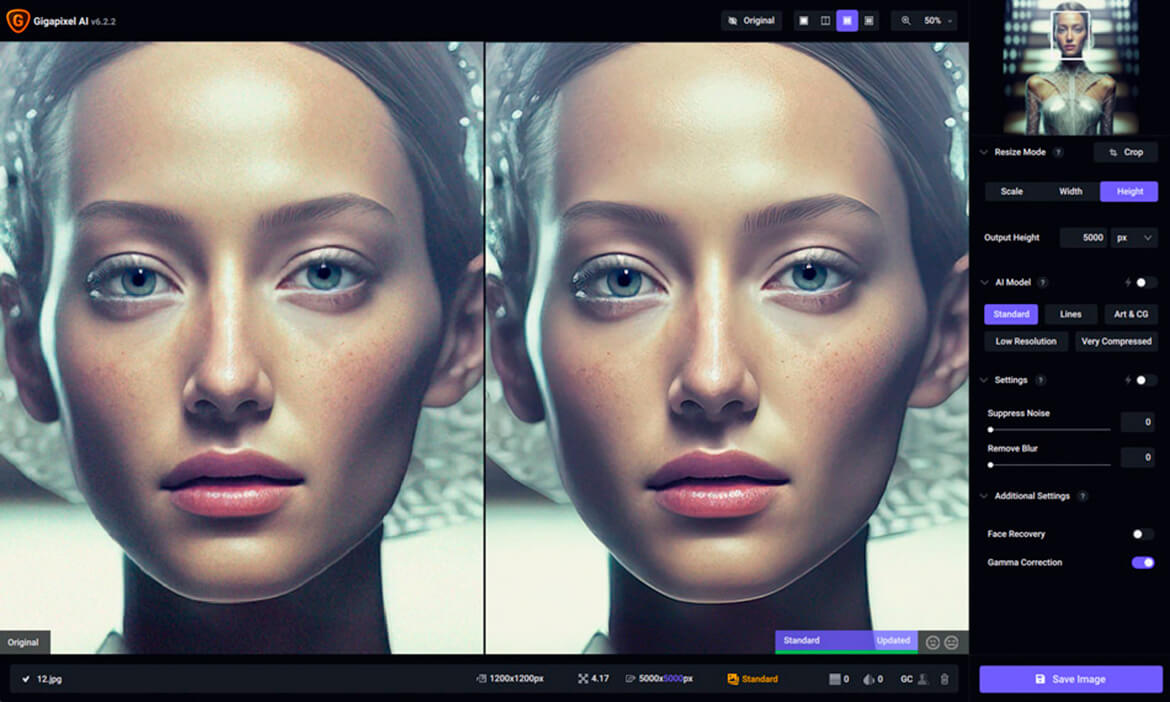

Mi primer encuentro con la tecnología IA desarrollada por Topaz Labs fue un poco más tarde y vino propiciado por una necesidad técnica, la de tener que usar material gráfico de un cliente para su proyecto de comunicación web, gran parte del cual estaba a tan baja resolución que ni siquiera llegaba a los mínimos aceptables para una correcta visualización en pantalla. Así que, tras probar a mejorar el material disponible con Photoshop con resultados bastante pobres, empecé a buscar opciones con otros softwares hasta que topé con Topaz Gigapixel AI, y ya desde la primera prueba, ampliando una imagen de tan solo 500 píxeles de ancho hasta los 1920 píxeles óptimos para una cabecera web a pantalla completa, tuve suficientes razones como para adquirir un pack completo de programas para mejorar imágenes que incluía también la última versión de Topaz Sharpen AI y, también, Topaz DeNoise AI, con el que se pueden conseguir auténticos milagros a la hora de reducir el ruido de una imagen, siempre que esta haya sido obtenido originalmente por medios digitales, ya que, en escaneados a partir de película química con mucho grano, la cosa no acaba de cuajar, al menos, por ahora.

La diferencia entre la herramienta Super Resolution de Adobe y el software de Topaz Labs es que, mientras que la primera solo permite trabajar a partir de un archivo RAW original de cámara, en el caso de Topaz Labs se puede partir, prácticamente, de cualquier tipo de archivo de imagen, sean formatos comprimidos como JPG o PNG, o formatos de artes finales como el TIF, con lo que no solo podemos conseguir ampliar y mejorar archivos a baja resolución, sino que también podemos aplicar a cualquier arte final una sustancial mejora en la resolución y la nitidez que nos permita mayores tamaños de salida para impresiones fotográficas o de imprenta. Y es en este punto, dónde he podido sacarle un gran partido al software de Topaz Labs, que me ha permitido aumentar la resolución de algunos proyectos fotográficos personales, como es el caso de las imágenes de Cuadraturas Mínimas, disparadas a lo largo de los años con cámaras de diferentes sensores, y reveladas y editadas, en su momento, sin aplicar ningún tipo de interpolación, y cuyas resoluciones originales no permitían, en especial con los archivos más antiguos, impresiones en papel fotográfico superiores a 25×25 cm sin que la calidad se resintiera.

Por tanto, no exagero a la hora de afirmar que, gracias a la inteligencia artificial, he podido remasterizar gran parte de las artes finales de mis proyectos fotográficos sin tener que empezar de cero con los archivos originales de captura, manteniendo así el acabado de la postproducción digital de cada imagen, y obteniendo formatos de salida para impresión en papel a tamaños considerables, a partir de resoluciones bastante más bajas, no solo sin perder la nitidez y el detalle de la imagen original, sino, además, mejorando estos y otros parámetros y dándole una oportunidad a mis fotografías y diseños como nuevo material en condiciones óptimas para proyectos expositivos

Por tanto, no exagero a la hora de afirmar que, gracias a la inteligencia artificial, he podido remasterizar gran parte de las artes finales de mis proyectos fotográficos sin tener que empezar de cero con los archivos originales de captura, manteniendo así el acabado de la postproducción digital de cada imagen…

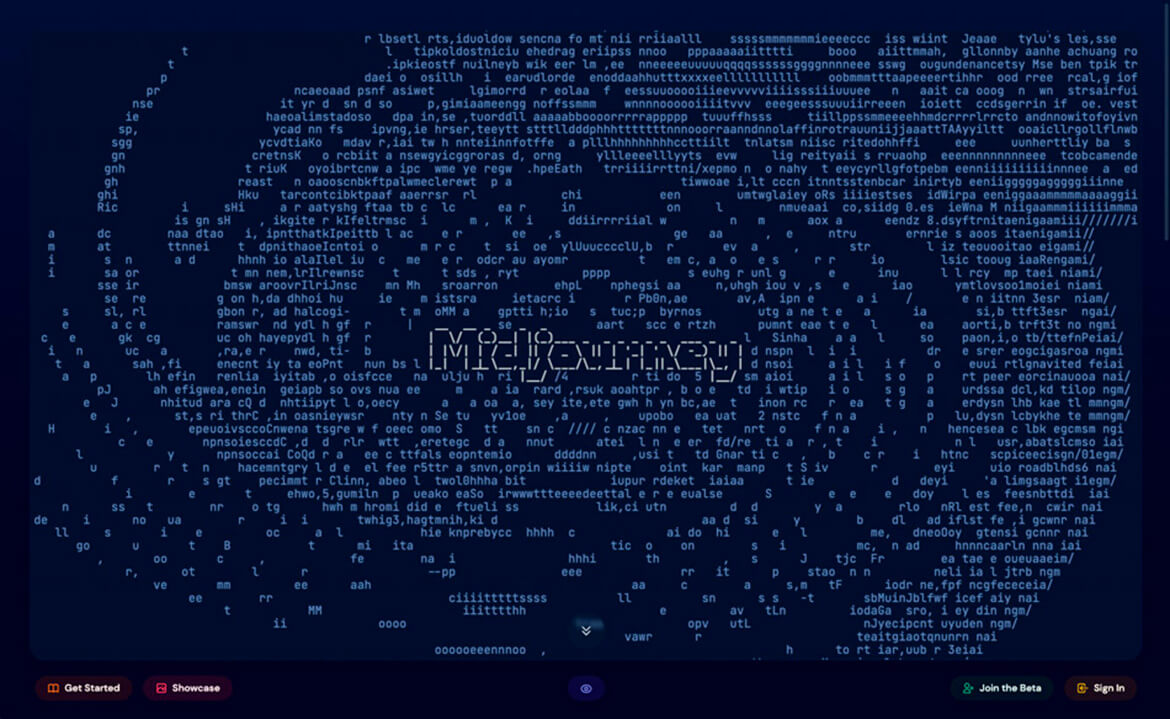

Y en eso llega Midjourney y el mundo creativo se tambalea

Hasta el verano del año pasado, mi experiencia con la IA no iba más allá del uso de esta como una potente herramienta para mejorar técnicamente mis procesos de trabajo digital, hasta que irrumpe en mi vida Midjourney y ante mí se abre una vía de investigación que va más allá de cuestiones técnicas (que las tiene, of course) y que, de repente, supone un auténtico revulsivo en lo concerniente a la concepción que hasta ahora tenía de lo que era un proceso creativo. La cuestión ya no era usar la IA para mejorar mis imágenes, sino explorar la IA como generadora de imágenes, algo que ya hacía DALL-E, tal y como os he contado al principio de este artículo, como también otros proyectos de IA generativa como Stable Difussion pero que, con Midjourney, la cosa ha adquirido una dimensión que, teniendo en cuenta que todavía estamos en los albores de esta tecnología, de seguir evolucionando a esta velocidad, no sería muy exagerado afirmar que estaríamos ante un importantísimo cambio de paradigma en la relación del ser humano con la tecnología.

El funcionamiento de Midjourney no es muy diferente al de otras IAs generativas. Se trata de introducir una descripción en texto, a la que llamamos prompt, a través de un programa informático (bot), en este caso en forma de chat en línea (no se puede descargar como app), formato que también usa otra de las IAs que están poniendo el mundo patas arriba (Chat GPT). Para acceder a la herramienta, que todavía está en versión beta, uno tiene que darse de alta en el canal oficial de Midjourney en Discord y una vez aceptada la invitación podrá acceder a los canales llamados Newbies que son los únicos en los que los nuevos usuarios pueden operar. Una vez elegido canal, lo primero que llama la atención es que todo el contenido que crean los otros usuarios es público, hasta el punto de que, no solo se pueden crear contenidos propios a partir de cero, sino también coger prestado el material generado por otros, asumiendo por supuesto, que dicho derecho es recíproco.

Con la versión gratuita se pueden disponer de una cuantas Fast Hours, que es al fin y al cabo a lo que uno tiene derecho una vez suscrito: disponer de tiempo para poder generar imágenes de manera rápida. Una vez agotado ese período de prueba, para conseguir más tiempo, y como si de la película In Time se tratara, toca ya rascarse el bolsillo y adquirir uno de los 3 planes de suscripción de pago que el sistema ofrece y que va de los 10 dólares mensuales a los 60, incluyendo este último la opción de trabajar en modo privado.

El secreto para la obtención de un buen resultado a través de Midjourney está en la manera en la que creamos los textos descriptivos (prompt), los cuáles, por ahora, funcionan bien si son en inglés, aunque a medida que la IA vaya engordando seguro que se podrá trabajar con ella sin ningún problema a partir de cualquier idioma. Dichos prompts ya no solo han de incluir texto descriptivo, sino que, además, podemos añadirle algunos caracteres a modo de comandos en los que podemos especificar cuestiones visuales como el aspecto, resolución, o el tipo de acabado que queremos, sea más realista o figurativo, como en una fotografía o como en una ilustración. Y a partir de ahí, a probar, probar y probar hasta conseguir las imágenes que uno desea, siempre que se tenga algún criterio y uno no se deje seducir tan fácilmente con la espectacularidad de los resultados y la rapidez con la que se obtienen.

En mi caso, llegar a unos resultados que me convenzan no ha sido algo de ayer para hoy, aunque reconozco que el proceso de aprendizaje, en el que todavía ando metido, es de una rapidez pasmosa. Por otro lado, también hay que tener en cuenta que la IA todavía tiene sus limitaciones y que ciertos aspectos de las imágenes que he generado a través de Midjourney han tenido que pasar por otros procesos, como es el caso de Photoshop para solucionar problemas a la hora de generar un rostro o una figura humana y, mira tú por dónde, también he tenido que echar mano de los Topaz AI para poder aumentar la nitidez de la imagen y la resolución del archivo final, ya que las imágenes generadas por Midjourney, por ahora, no superan los 1.792 x 1.024 píxeles.

Muy bien ¿y cuál es el problema?

Pues aquí es dónde toca abrir el melón, o la caja de Pandora como dicen los más agoreros.

Estamos ante una tecnología que crea contenidos en segundos, en este caso visuales, a partir de una mera descripción textual, más o menos compleja, con lo que todo el proceso de captación o creación de imagen, tal cual hemos conocido hasta ahora (fotografiar, dibujar, diseñar…) desaparece y lo único que tenemos que hacer es dirigir y educar a esa inteligencia artificial para que sea ella misma la que ejecute aquello que tenemos en mente. Por intentar explicarlo de un modo más sencillo, es como que cualquiera puede ahora asumir el rol de director artístico o director creativo, como ya existe en campos como la publicidad o el cine, pero con la diferencia de que en lugar de tener un equipo de profesionales completo a tu servicio (dentro de las posibilidades de producción que tuviera cada uno), ahora es una única tecnología la que es capaz de sustituir gran parte de los procesos de producción audiovisual y generar una obra creativa con una calidad de ejecución sorprendente y en tiempo récord.

Esto crea un primer dilema sobre la autoría de dichas imágenes. ¿Quién es el creador de la obra? ¿La máquina o quién dirige la máquina? Y es aquí donde uno tiene que echar mano a su propia hemeroteca mental para intentar buscar equivalentes, salvando las distancias, entre la experiencia actual con la IA y otras experiencias anteriores sin la IA.

Esto crea un primer dilema sobre la autoría de dichas imágenes. ¿Quién es el creador de la obra? ¿La máquina o quién dirige la máquina?

En mi caso, mi introducción en el mundo del diseño gráfico, a finales de los años 90 vino a raíz de la adquisición de mi primer equipo informático para trabajar con la imagen, lo cual me llevó a ser maquetador de algunos diseñadores gráficos que, tras años creando contenidos de manera artesanal, como por ejemplo collages, no supieron adaptarse en su momento a la imparable irrupción de las nuevas tecnologías. Mi trabajo para ellos consistía en generar los contenidos gráficos a través de programas como Freehand, Corel Draw o Adobe Illustrator y maquetar las obras siguiendo las indicaciones del diseñador, el cuál simplemente se sentaba a mi lado y me iba diciendo como disponer en pantalla de cada elemento, color, forma, etcétera, hasta llegar a un resultado final satisfactorio para este… Dicho esto, ¿quién creéis que firmaba como autor de las obras o diseños finales?, ¿el diseñador o el maquetador?

No intento dar respuestas porque yo mismo me encuentro en la necesidad de buscarlas mientras llevo a cabo este proceso de investigación, pero sí creo que, en el caso de la autoría de una imagen generada mediante inteligencia artificial, la cuestión no es más que la punta del iceberg de lo que verdaderamente se oculta bajo la superficie. No es tanto un dilema sobre la autoría, sino más bien, la desazón que sin duda produce el hecho de pensar que una única máquina sea capaz de reproducir los procesos para los que, hasta ahora, era preciso disponer de un equipo humano, en mayor o menor medida, para poder ejecutarlos según las directrices de un director. Por lo tanto, ¿de qué estamos hablando? ¿de autoría o de roles profesionales y, en consecuencia, puestos de trabajo que pueden ser arrasados con la irrupción de esta tecnología?

Por otro lado, está la cuestión legal en lo concerniente al funcionamiento de las IAs y de cómo se nutren estas a la hora de generar contenidos y, ahí, tal y como pasa con los algoritmos creados por las grandes tecnológicas, la cosa es más opaca. Porque no podemos obviar que las IAs generativas, a la hora de crear contenidos, se alimentan y aprenden de todo el material audiovisual cargado en Internet, sea sujeto a derechos de autor o propiedad intelectual o sin estar sujeto a ello. Pero claro, si nos atenemos al funcionamiento de un programa de inteligencia artificial como Midjourney, Dall-E o Stable Difussion, hasta lo que podemos conocer, lo que estas aplicaciones hacen no es muy diferente a lo que pueda hacer un barman al introducir en una coctelera un montón de ingredientes originales que son ‘agitados’ a cierta velocidad para que estos se mezclen creando un brebaje que, con independencia de que en él se puedan intuir los sabores y aromas de las materias primas que lo componen, no deja de ser, al final del proceso, una bebida con entidad propia, algo que, trasladado a la legalidad sobre la propiedad intelectual de las imágenes ya se contempla cuando se habla de obra original y obra derivativa, no sin ciertas controversias.

Porque no podemos obviar que las IAs generativas, a la hora de crear contenidos, se alimentan y aprenden de todo el material audiovisual cargado en Internet, sea sujeto a derechos de autor o propiedad intelectual o sin estar sujeto a ello.

¿Y si un día son las propias tecnológicas que están detrás de las IAs las que reclaman en sus condiciones de uso la propiedad intelectual de las imágenes generadas? Por lo pronto, tanto Midjourney como Dall-E o Stable Difussion no contemplan hoy en día esto en sus términos de uso. Es más, según dichos términos el supuesto copyright de los contenidos generados a través de sus programas de inteligencia artificial es, por ahora, propiedad de quién (no del ‘qué’) genera dichos contenidos. Pero esto no ha impedido que, en EEUU, hayan surgido ya las primeras demandas contra estas tecnológicas por parte de ilustradores y creadores artísticos por vulneración de los derechos de autor, algo que por ahora es difícil saber su recorrido en un momento en que la legislación mundial, seguramente pillada también con el pie cambiado, va a tener que evolucionar para dar cabida a lo que está por llegar con respecto al uso de la IA, y no únicamente en lo que afecta al sector creativo audiovisual.

¿Conclusiones?

Pues ahora, por mi parte, pocas. Más preguntas que respuestas que van a tener que resolverse a corto y medio plazo, porque lo que sí tengo claro es que la inteligencia artificial, en un período relativamente breve de tiempo (menos de 5 años) va a ser parte indisoluble de nuestra existencia, sea tecnológica o no, del mismo modo en que, en su momento, pasó con la irrupción de Internet y, posteriormente, la eclosión de las redes sociales y el impacto indiscutible que todo esto ha supuesto para la humanidad, tanto para bien como para mal.

Como ya he comentado al principio de este post, yo nunca me he cerrado a los avances tecnológicos. Sin ellos, hoy no podría hacer nada de lo que hago, tanto a nivel profesional como creativo. Pero esto no significa que uno reciba cualquier avance con los brazos abiertos, como si nada.

Nunca he pensado que la tecnología sea un problema. Todo lo contrario. Nadie puede negar que los avances tecnológicos han contribuido de manera contundente a mejorar nuestras vidas y, en el caso de la inteligencia artificial, no tengo duda de que va a propiciar un salto importante en este aspecto. Al fin y al cabo, la automatización de los procesos debería servir para que los creadores puedan ocupar mejor su tiempo creando y poder desarrollar sus proyectos creativos de una manera factible, accesible y ágil.

Al final, para mí, es una cuestión de probar las cosas, investigar, y valorar con mi propia experiencia tanto los beneficios como los problemas que cualquier nueva tecnología pueda derivar, tratando de buscar el equilibrio entre las convicciones personales y la aceptación de lo inevitable.

Pero el problema es que cualquier avance tecnológico de gran calado conlleva una serie de consecuencias que no siempre son positivas. Es el peaje que el progreso nos hace pagar (que nada es gratis) por poder disfrutar (o no) de esos avances y que, posiblemente, tenga más que ver con los usos que el ser humano le da a la tecnología, a menor o mayor escala y de una paradoja difícil de entender en plena era de acceso libre y gratuito a la información y el conocimiento a través de Internet: la de que el ritmo y la velocidad a la que avanza la tecnología, muchas veces, no se ve reflejada en el ritmo y la velocidad a la que avanzan las cabezas pensantes de demasiada gente y uno no puede evitar preguntarse si en verdad el ser humano, todavía tan primitivo en tantos aspectos, está preparado para entender y gestionar todo ese potencial tecnológico con sentido común y sentido crítico.

Al final, para mí, es una cuestión de probar las cosas, investigar, y valorar con mi propia experiencia tanto los beneficios como los problemas que cualquier nueva tecnología pueda derivar, tratando de buscar el equilibrio entre las convicciones personales y la aceptación de lo inevitable. Y la inteligencia artificial ya es algo inevitable. Es otro tren a alta velocidad (altísima en este caso) en el que uno ha de decidir si subirse o dejarlo pasar y evitar que le arrolle.

Y de estos ‘trenes’ ya llevo unos cuantos en mi vida.

¿Continuará?

Hola Nat! Me encanta la entrada de blog y tu análisis. Soy profesor de secundaria, y he visto como en estos años ha habido un salto tecnológico, ya no a nivel profesional solo, sino también a nivel de usuario básico, por medio de toda una serie de plataformas online que hace muy accesible el diseño gráfico de una forma sencilla, Intuitiva y proporcionando plantillas modificables que lo que favorecen es que cualquier usuario, sin conocimientos técnicos específicos (como nuestros alumnos), sean capaces de generar pósters, flyers, cabeceras para webs…. Y desde no hace mucho también podemos encontrar lo mismo no… Leer más »

Hola Víctor. En primer lugar, agradecerte el interés y tu comentario. Como profesional del sector audiovisual creo que hay que ver la diferencia entre lo que es un producto como una plataforma online en la que cualquier usuario sin conocimientos técnicos pueda conseguir unos resultados que le sirvan a sus intereses, y lo que es un producto personalizado en el que no solo se tiene en cuenta la parte técnica, sino también otros aspectos a desarrollar desde un perfil creativo y controlando ciertos lenguajes de la comunicación audiovisual o de la publicidad. Estamos hablando de dos necesidades diferentes y, sin… Leer más »

Gracias Nat. El futuro siempre es incierto, pero inequivocamente vamos hacia él. Mejor verlo de forma esperanzadora. Un placer leerte!